As Leis da Física que Ninguém Conta pra Você

Enquanto todo mundo fala em “crescimento exponencial da IA”, a física está ali no canto, rindo baixinho.

Existe uma narrativa dominante no mundo tech: a IA vai crescer exponencialmente, sem limites, até dominar tudo. Os modelos vão dobrar de tamanho, as GPUs vão empilhar aos milhares, e em breve teremos uma superinteligência tomando café conosco.

Só que não.

A matemática e a física têm um recado claro: existem paredes invisíveis que nenhuma Big Tech consegue derrubar com dinheiro. E elas já estão batendo na porta.

🧱 Lei de Amdahl — O Gargalo que Não Escala

Imagine que você tem uma tarefa onde 10% do trabalho precisa ser feito em sequência — uma parte atrás da outra, sem atalho. A Lei de Amdahl diz que não importa se você jogar 1.000, 10.000 ou 1 milhão de GPUs no problema: o speedup máximo é 10x. Ponto final.

Na prática do treinamento de IA, essas partes sequenciais são reais: sincronizações entre nós, operações de I/O, gargalos de comunicação. Cada GPU adicionada tem retorno decrescente. É como colocar 50 cozinheiros pra fazer um bolo — em algum momento, eles ficam esperando o forno.

O que isso significa: escalar horizontalmente (mais hardware) tem limite matemático. O futuro não é “mais GPUs”, é “algoritmos mais espertos.”

📉 Lei de Moore — A Festa que Está Acabando

Por décadas, a Lei de Moore foi o motor silencioso da revolução digital: transistores dobrando a cada ~2 anos, chips mais rápidos, mais baratos, mais densos.

Desde ~2015, essa curva desacelerou. Estamos nos limites da litografia — os transistores já estão na escala de poucos átomos. Fabricantes como NVIDIA e Google recorrem a arquiteturas especializadas (TPUs, NPUs), mas o crescimento exponencial bruto acabou.

Tradução: os modelos de IA ficaram gigantes apostando que o hardware continuaria barateando exponencialmente. Essa aposta está vencendo.

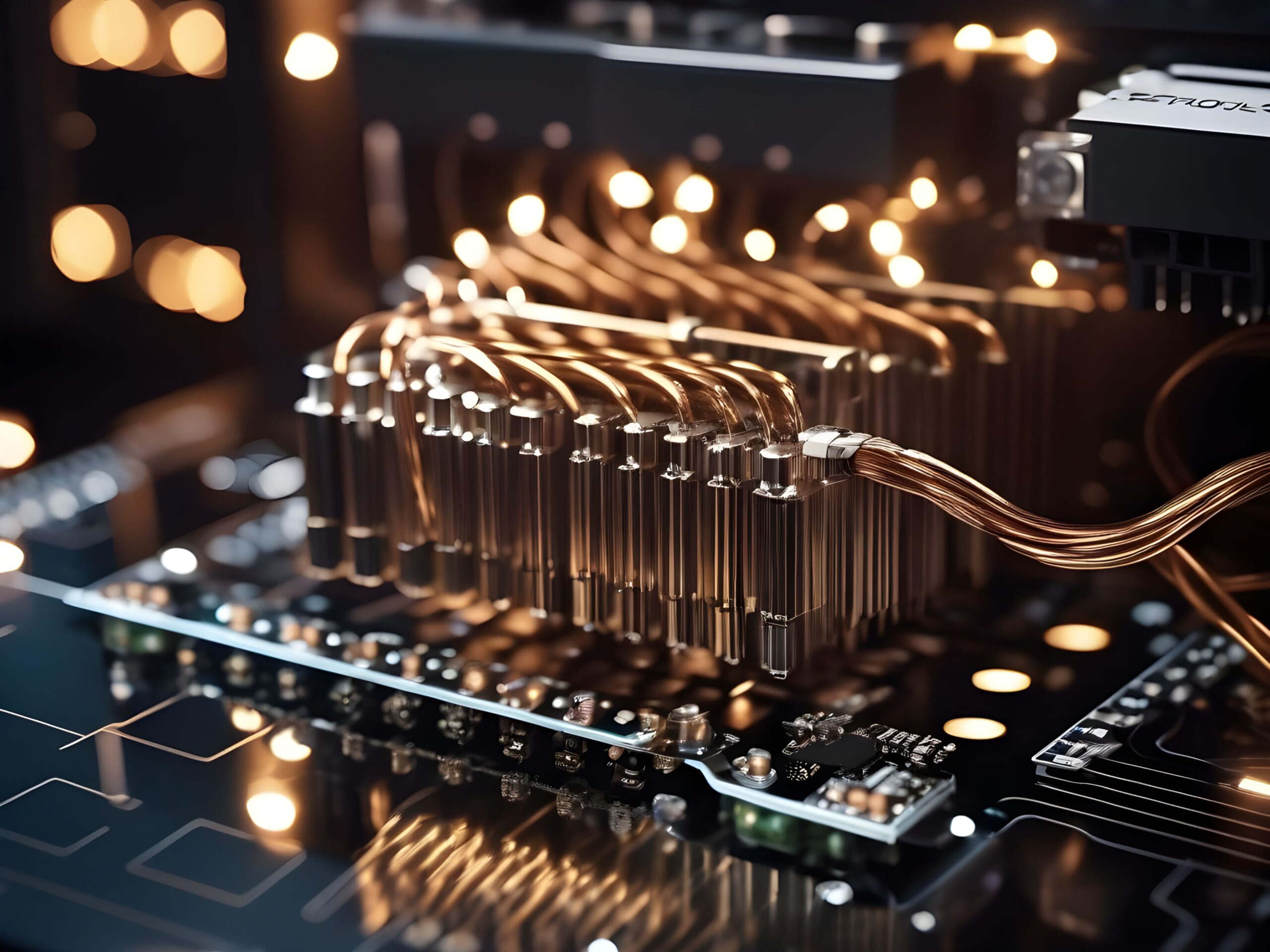

🔥 Escala de Dennard — O Muro de Calor

A Escala de Dennard prometia algo mágico: transistores menores consumiriam proporcionalmente menos energia. Isso quebrou por volta de 2006. O resultado? O temido power wall.

Hoje, GPUs de data center geram tanto calor que partes dos chips precisam ficar desligadas para não derreter — é o chamado “dark silicon”. Treinar um modelo de fronteira consome gigawatts. Não é exagero: estamos falando de consumo equivalente a cidades inteiras.

Na prática: escalar modelos de IA está se tornando um problema energético e térmico antes de ser um problema computacional.

⚛️ Os Limites que a Física Impõe

E quando achamos que acabou, tem mais:

Barreira de Landauer — existe um custo mínimo termodinâmico para apagar um único bit de informação: kT ln(2). Parece pouco, mas em escala de trilhões de operações, isso define um piso de consumo energético que nenhuma engenharia supera.

Velocidade da luz — em clusters distribuídos globalmente, a latência de comunicação entre nós é limitada por c. Não importa quanta fibra óptica você tenha: a luz não vai mais rápido.

Problema da parada — a teoria da computabilidade nos lembra que existem problemas que nenhum computador resolve, independente de quão poderoso seja. A IA geral esbarra nessas barreiras intransponíveis.

🔮 E Agora? O Que Vem Depois do “Mais Grande”?

Se empilhar hardware tem limite, o caminho é outro. As apostas mais promissoras:

- Algoritmos mais eficientes — fazer mais com menos (MoE, quantização, destilação)

- Computação neuromórfica — chips que imitam sinapses biológicas

- Computação termodinâmica — usar a própria física a favor, não contra

- Modelos menores e especializados — nem tudo precisa ser um modelo de 1 trilhão de parâmetros

A corrida da IA não vai parar. Mas a direção muda: de “escala bruta” para “eficiência inteligente.”

💡 O Ponto Principal

A narrativa de crescimento infinito da IA é sedutora, mas fisicamente impossível. As leis de Amdahl, Moore, Dennard e a própria termodinâmica dizem que o futuro da IA não será definido por quem tem mais GPUs, mas por quem usa melhor o que tem.

E talvez essa seja a parte mais interessante da história.

Se você chegou até aqui, parabéns — agora sabe mais sobre os limites da IA do que 99% das pessoas que postam sobre “singularidade” no LinkedIn.

Curtiu? Compartilha com aquele amigo que acha que a Skynet é questão de tempo.